合作机构:阿里云 / 腾讯云 / 亚马逊云 / DreamHost / NameSilo / INWX / GODADDY / 百度统计

资讯热度排行榜

- 43211Windows serve

- 23092IDC选址逻辑:市场需求决

- 15783联想百应&长沙电信

- 15754数据中心行业购电协议(PP

- 15265热化学储能在为数据中心供电

- 15226数据中心面临人员短缺和减少

- 15167如何计算和减少网络中的光纤

- 15108什么是数据中心的交叉连接?

- 14759数据中心800G收发器市场

- 146210数据中心高温管理指南

推荐阅读

- 12-291数据中心机房设备布局规划

- 01-0522023年数据中心年度盘点

- 01-103数据中心是否尽可能实现碳中和?

- 01-114可持续技术:2024 年技术趋势

- 01-1752024年数据中心存储趋势

- 01-236什么是数据中心现代化?

- 01-247人工智能、5G和物联网如何刺激边

- 01-258数据中心有哪些物理安全威胁?

- 01-2692024年对数据中心及其基础设施

- 01-1610算力突围:打造AI浪潮下的坚实底

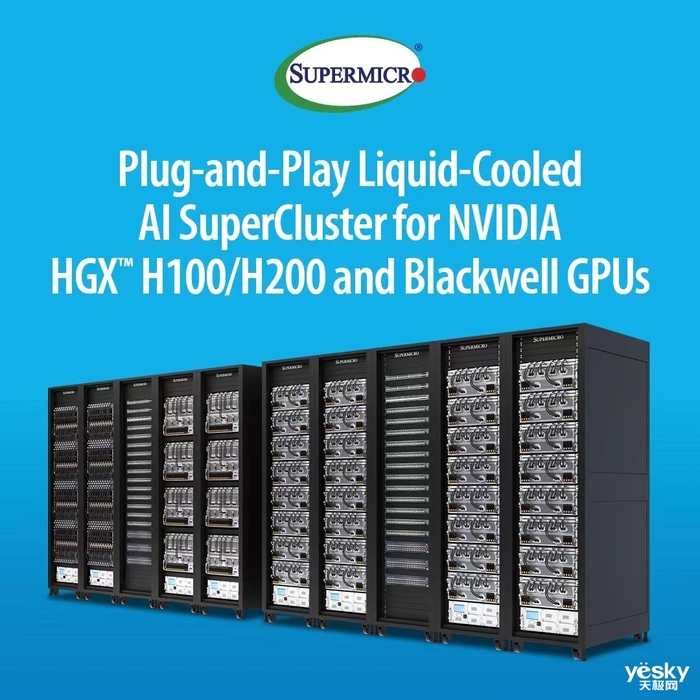

Supermicro推出适配NVIDIA Blackwell机柜级即插即用液冷AI SuperCluster

【天极网企业频道】日前,Supermicro推出专为云原生解决方案而设计的可立即部署式液冷型AI数据中心。该数据中心适配NVIDIA Blackwell和NVIDIA HGX H100/H200,通过SuperCluster加速各界企业对生成式AI的运用,并针对NVIDIA AI Enterprise软件平台优化,适用于生成式AI的开发与部署。

在大模型、生成式AI带动下,AI正加速融入千行百业,而且在AI自身技术与能力演进的同时,也带来了业务模式的创新。AI浪潮也导致市场对于AI智算能力需求的快速增长,与需求多样化扩展。再加上企业对于总体拥有成本(TCO)与能效的关注,作为关键底层的数字基础设施也需要加速演进。

因此,Supermicro提供的全新产品及解决方案不仅满足了AI推理训练等工作负载对于算力的迫切需求,同时凭借快速部署、灵活拓展,以及液冷解决方案等提升,降低了企业、数据中心的能耗及运维等成本。

据介绍,通过Supermicro的4U液冷技术,NVIDIA近期推出的Blackwell GPU能在单一GPU上充分发挥20PetaFLOPS的AI性能,且与较早的GPU相比,能提供4倍的AI训练性能与30倍的推理性能,并节省额外成本。配合此率先上市的策略,Supermicro推出的基于NVIDIA Blackwell架构的完善产品系列,支持新型NVIDIA HGXTM B100、B200和GB200 Grace Blackwell Superchip。

Supermicro总裁兼首席执行官梁见后表示:“Supermicro在打造与部署具有机柜级液冷技术的AI解决方案方面持续领先业界。数据中心的液冷配置设计可几近免费,并通过能持续降低用电量的优势为客户提供额外价值。我们的解决方案针对NVIDIA AI Enterprise软件优化,满足各行各业的客户需求,并提供世界规模级效率的全球制造产能。因此我们得以缩短交付时间,更快提供搭配NVIDIA HGX H100和H200,以及即将推出的B100、B200和GB200解决方案的可立即使用型液冷或气冷计算丛集。从液冷板到CDU乃至冷却塔,我们的机柜级全方位液冷解决方案最大可以降低数据中心40%的持续用电量。”

NVIDIA创始人兼首席执行官黄仁勋表示:“生成式AI正在推动整个计算堆栈的重置,新的数据中心将会通过GPU进行计算加速,并针对AI优化。Supermicro设计了顶尖的NVIDIA加速计算和网络解决方案,使价值数兆美元的全球数据中心能够针对AI时代优化。”

在本周举行的COMPUTEX 2024展会期间,Supermicro也展示了即将推出,并针对NVIDIA Blackwell GPU优化的系统,包括基于NVIDIA HGX B200的10U气冷系统和4U液冷系统。Supermicro也将提供8U气冷型NVIDIA HGX B100系统、NVIDIA GB200 NVL72机柜(具有72个通过NVIDIA NVLink 交换器互连的GPU)与新型 NVIDIA MGX系统(支持NVIDIA H200 NVL PCIe GPU与最新发布的NVIDIA GB200 NVL2架构)。

Supermicro目前的生成式AI SuperCluster产品包括:

液冷型Supermicro NVIDIA HGX H100/H200 SuperCluster,具有256个H100/H200 GPU,为5个机柜规模的可扩展计算单元(包括 1 个专用网络机柜)

风冷型Supermicro NVIDIA HGX H100/H200 SuperCluster,具有256个HGX H100/H200 GPU,为9个机柜规模的可扩展计算单元(包括1个专用网络机柜)

Supermicro NVIDIA MGX GH200 SuperCluster,具有256个GH200 GraceTM Hopper Superchip,为9个机柜规模的可扩展计算单元(包括1个专用网络机柜)

Supermicro的SuperCluster支持NVIDIA AI Enterprise,其中包括NVIDIA NIM微服务和NVIDIA NeMo平台,能实现端对端生成式AI客制,并针对NVIDIA Quantum-2 InfiniBand以及具有每GPU 400Gb/s网速的新型NVIDIA Spectrum-X以太网络平台优化,可扩展到具有数万个GPU的大型计算丛集。

Supermicro即将推出的SuperCluster产品包括:

液冷型Supermicro NVIDIA HGX B200 SuperCluster

风冷型Supermicro NVIDIA HGX B100/B200 SuperCluster

液冷型Supermicro NVIDIA GB200 NVL72 或 NVL36 SuperCluster

除了高算力、高能效外,Supermicro与NVIDIA的合作及服务整合,可简化运维、快速部署,实现降本增效。其云原生AI SuperCluster使实时存取的云端便利性和可移植性之间得以连结,并通过与NVIDIA AI Enterprise、NIM微服务整合,让任何规模的AI项目从评估测试阶段无缝顺畅地进行到实际作业阶段。这提供了能在任何地方运行并安全管理数据的灵活性,包括自建系统或本地大型数据中心。

其中,NVIDIA NIM微服务作为NVIDIA AI Enterprise的一部分,可在无缺陷情况下提供托管生成式AI和开源部署优势。其多功能推理运行环境通过微服务,可加速从开源模型到NVIDIA基础模型等各类型生成式AI的部署。此外,NVIDIA NeMoTM可实现通过数据管理、进阶自定义和检索增强生成(Retrieval-Augmented Generation,RAG)的客制模型开发,以实现企业级解决方案。与搭配NVIDIA AI Enterprise的Supermicro SuperCluster整合后,NVIDIA NIM能为可扩展、加速型生成式AI作业的部署提供最快途径。

Supermicro的SuperCluster解决方案针对LLM训练、深度学习以及大规模与大批量推理优化。Supermicro的L11和L12验证测试及现场部署服务可为客户提供无缝顺畅体验。客户收到即插即用的可扩充单元后即可在数据中心轻松部署,进而更快取得效益。

-

TOP